Archéologie d’une mémoire impossible

Lorsque l’on regarde la très grande majorité des images issues des IA génératives sans qu’on en prenne conscience notre esprit reconnaît des sources, des origines, en bref a intuitivement accès à un ensemble de données images qui ont été digérées dans le processus de la création du modèle. Les modèles des IA sont construits selon une indexation des images obéissant à notre représentation.

En ce sens l’imaginaire de la machine est construit sur un déterminisme de la perception et de la mémoire humaine. Certes, l’imagination artificielle ne fonctionne pas comme la nôtre, mais du fait du déterminisme catégoriel établi à la fois dans les modèles-images et dans leur correspondance linguistique, l’imaginaire artificiel se conforme à une mémoire que nous avons de nos images.

Olivier Auber a très rapidement décelé ce biais cognitif à travers ses portraits . La génération IA mettait en évidence selon un point aveugle (anoptikon) pour l’utilisateur, la logique d’indexation de nos propres images et de leur logique. C’est en ce sens que les portraits de directeurs de musées, de sociologues (etc) générés se constituent comme des miroirs révélateurs de notre propre logique de mémorisation par l’image. Ce biais cognitif a bien été perçu par les producteurs d’IA, mais il n’est pas facile à rectifier comme nous avons pu le voir avec les nazis ou vikings noirs de Gemini .

.

Ce biais génératif repose sur le fait que l’apprentissage est lié à un découpage du monde selon notre propre logique. Si je veux qu’il y ait des mains, je vais nourrir d’images de mains une IA, et je vais sous-catégoriser ensuite les types de mains (mains ouvertes, fermées, qui tient un objet, etc). La génération de la main ne vient pas de rien, mais d’un apprentissage et de son renforcement. Ainsi, je n’aurai jamais de surprise quand je demanderai de faire une main, ce sera bien une main qui apparaîtra. Certes au tout début des IA génératives, on a pu percevoir à quel point il a été difficile pour les IA de faire des mains, toutefois, comme on le constate avec midjourney ou bien dall-e 2, cette difficulté a été dépassée.

Cependant si au lieu d’utiliser des modèles existant, nous produisons nous même nos modèles que peut-on induire au niveau de la génération ?

Peut-il y avoir encore dans notre perception, celle du regardeur qui n’a pas eu accès à la formation du modèle, une appréhension des images constitutives du modèle ?

C’est le travail que je fais depuis pas mal de mois avec la construction de mes propres modèles. Amener qu’il y ait une forme d’impossibilité archéologique de la mémoire des images. Une suspension de la reconnaissance. Un échec dialectique de l’appropriation ontologique de l’image.

L’appropriation ontologique repose sur la réduction de la machine au simple instrument.

L’imagination artificielle est réduite à être un outil pour l’intentionnalité promptologique de la conscience.

En amenant une IA à produire un modèle, il s’agit de rompre avec la perception humaine, et d’interroger comment l’IA perçoit des possibilités statistiques dans des données hétérogènes.

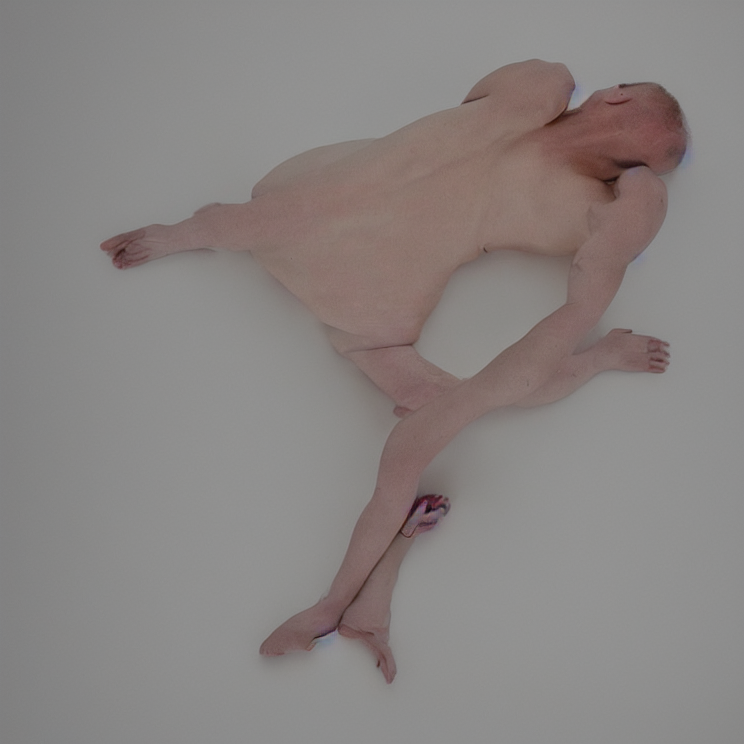

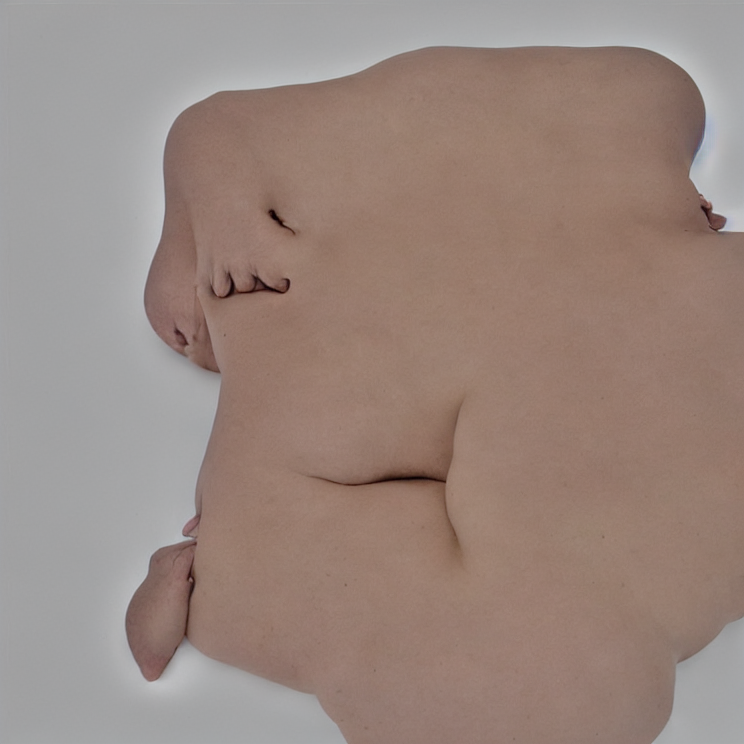

C’est en ce sens que les images de cette série obéisse à un modèle où j’ai mêlé : à la fois des corps humains, des cordes de bateau nouées, et des ensembles minéraux. Il a été conçu sur environ 10000 images. Et il obéit seulement au prompt body et à un poids.

Le prompt général : « un corps dans une pièce blanche » (a body in a white room)

Aucune prédication de difformité. Aucune volonté de produire de la déformation. Il s’agit de laisser survenir le possible de l’image selon l’imagination artificiel.

Ce qui ressort tient de l’induction statistique et du corps latent suspendu en puissance dans le modèle.

Chaque génération survient alors comme une surprise, car je ne peux apriori anticiper (notamment au début) ce qu’a perçu et comment sera généré la corporéité. Le corps généré n’est ps imparfait, mais il est parfait selon la perception et l’apprentissage de l’IA. Il s’agit strictement d’un pararéalisme de la forme du corps. D’une autre réalité. Pour notre perception, l’archéologie de l’image est suspendue, car intuitivement, nous ne pouvons saisir de quelle manière cela s’est formé.